2012年版で「ブクマ数2桁いきたい」と言っていたら2013年は3桁が出ました(驚

やっぱりライブラリの紹介とか流行りものとかが強いみたいですね

以下トップ10の簡単な紹介

データ分析と機械学習とアルゴリズムの記事しかないですね

ニコニコ動画のデータセットが公開されたらしい - 唯物是真 @Scaled_Wurm

ニコニコ動画のデータセットが公開されたので簡単に試してみた記事

バズった瞬間に一時的にブクマされたけど、それ以降はあまりブクマされてない傾向

公開から結構たつけど、観測範囲の問題なのか、それともデータの使いづらさの問題なのか、ニコ動データセットを使った他のブログ記事とかはあまり見かけないですね……

私が見かけたのはニコニコ学会βデータ研究会の発表と以下の記事ぐらい

pythonの機械学習ライブラリscikit-learnの紹介 - 唯物是真 @Scaled_Wurm

Pythonの機械学習ライブラリscikit-learnの紹介記事

使いやすいのでおすすめです、日本語情報が少ないような気もしますが

機械学習が流行ってるおかげなのか、わりと継続的にブクマが増えている

新機能とか紹介してない機能とか、他の機械学習系のライブラリとかも記事にしたいけど、なかなか時間がなくてできてない

あと最近話題のDeep Learningのライブラリが気になります

どこかにわかりやすい記事がないかなぁ

小説家になろうのランキングをトピックモデルで解析(gensim) - 唯物是真 @Scaled_Wurm

Web小説(のタグ)にトピックモデル(LDA)を試してみた記事

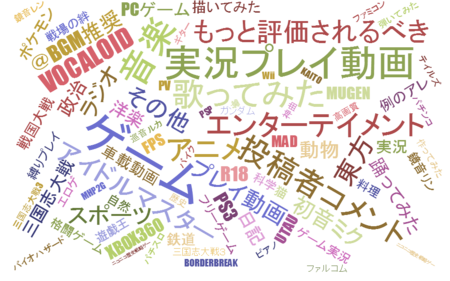

トピックモデルの話よりもタグクラウドでの可視化の方が目立っているような気も……

トピックモデルを小説に適用する話だと最近書かれた以下の記事が面白かったです

Twitterの投稿時間で類似度を計算してみた - 確率分布の類似度 - 唯物是真 @Scaled_Wurm

確率分布の類似度を計算する話

みんな大好き(?)KLダイバージェンスとかを使ってTwitterの投稿時間分布の差を調べています

論文紹介 “Representing Topics Using Images” (NAACL 2013) - 唯物是真 @Scaled_Wurm

トピックモデルで推定したトピックに適切な画像を選ぶ話

論文紹介がブクマされるのは珍しいのでびっくり

画像がたくさん出てくるからわかりやすかったのかな(?)

あんまり画像の分野には詳しくなかったので、bag of visual wordsとかの特徴量について調べるのが面白かったです

Lossy Countingを実装してみた - 省メモリな頻度計測 - 唯物是真 @Scaled_Wurm

ある程度誤差を許す代わりに、メモリを節約して頻度を数える方法

Python用のトピックモデルのライブラリgensim の使い方(主に日本語のテキストの読み込み) - 唯物是真 @Scaled_Wurm

上の方の記事でも使ったPythonのトピックモデルのライブラリgensimの使い方

最近Deep Learningを使って意味をとらえた単語のベクトルを作るプログラムのword2vec

CrowdSolving第1回コンペに参加しました 5/43位 - 唯物是真 @Scaled_Wurm

和製kaggleといっていいのかわかりませんが、機械学習の賞金付きコンペのCrowdSolvingに参戦した記録です

SVMとかを実際に色々いじくるのはこの頃が初めてだったの色々勉強になりました

他のコンペにも参加したのでついでに載せときます

キャラソートのアルゴリズムについて調べた - 唯物是真 @Scaled_Wurm

いわゆるキャラソートのアルゴリズムについて調べた後、上位k件までソートする方法についても調べています

記事中でリンクした記事の著者の方に反応してもらえたのが嬉しかったです

リファラから URL "キャラソートのアルゴリズムについて調べた" という記事を見ている。上位しかどうせ表示しないというのが結構あるんですね。ふむー

2013-11-06 12:39:56 via web

バケツソート系ので5段階評価くらいはしてくれ、とやるのが実用的には速いだろうけど、キャラソートって、好きなキャラにそんな明確な順位なんてつけられないよ、というところを、無理やり二択にまで問題を落として選ばせることである種マジカルに順位を決定しちゃうという無理矢理感が肝なので (続

2013-11-06 12:43:23 via web

続) 比較の二択の繰り返しのみで選ばせるスタイルは維持しつつ、上位だけ真面目に聞いて、下の方は過去の他の回答者の履歴とかから勝手に類推して適当に決め打って(シリーズのこの作品はあんまり趣味じゃないんだなとかこの属性が〜とか) n/log n 回くらいで決めつけるのが面白そう

2013-11-06 12:46:36 via web

同じ日にこの方がつぶやいていた、一定確率で比較を間違える場合のソートの話も面白かったです

k回に1回失敗とかのモデルだと複数回試すので指数的によくなっちゃう(論文にも書いてあるけど)のでなんかうまいこと捻らないと非自明な問題になりにくい気がする

LIBSVMとかLIBLINEARとかのメモ - 唯物是真 @Scaled_Wurm

機械学習のライブラリのLIBSVMやLIBLINEARでいろんな評価尺度を出力したり、確率値を出したり、並列化したりする方法のメモ

あと以下の重みを見る方法の記事とかも役立つと思います

ちなみに上で紹介したscikit-learnを使えば関数一つで重みが見れたりします